El desarrollador de Unreal Engine, Epic Games, lanzó Live Link Face, una aplicación para iPhone que utiliza los sensores 3D frontales del teléfono inteligente para capturar movimiento en vivo para animaciones faciales en proyectos 3D como videojuegos, animaciones o películas.

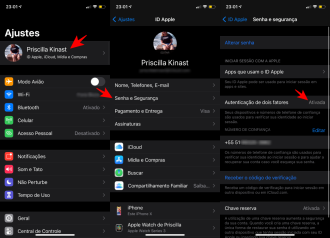

La aplicación utiliza herramientas del marco ARKit de Apple y el sensor TrueDepth del iPhone para transmitir la captura de movimiento en vivo de un usuario que mira su teléfono inteligente para capturar personajes en 3D en el Unreal Engine que se ejecuta en una estación de trabajo cercana. Captura las expresiones faciales, así como la rotación de la cabeza y el cuello.

Live Link Face puede transmitir a varias máquinas al mismo tiempo, y "el soporte sólido de código de tiempo y la precisión precisa de los cuadros permiten una sincronización perfecta con otros componentes del escenario, como cámaras y captura de movimiento del cuerpo", según la publicación de blog de Epic en el anuncio de la aplicación. Los usuarios obtienen un CSV de los datos sin procesar de la forma combinada y un MOV de la cámara de video frontal del teléfono inteligente, con códigos de tiempo.

Para muchos, el conjunto de sensores TrueDepth del iPhone no parecía necesario, todos estaban felices de que Touch ID funcionara bien para los propósitos de la mayoría de las personas en iPhones anteriores, y no había muchas aplicaciones claras de la tecnología además de Face ID y Animojis, y nada. otra cosa que justificaría la tecnología.

Ahora con esta aplicación, aunque para una audiencia restringida: los desarrolladores de juegos y cineastas independientes pueden usar aplicaciones como esta en el iPhone para la captura de movimiento, dando vida a personajes virtuales con expresiones faciales y otros movimientos de actores humanos reales. Esto es algo que tradicionalmente involucraría estudios caros fuera del alcance de todos menos de los grandes jugadores.

La captura de movimiento que pueden gestionar los sensores del iPhone no es tan precisa como la que utilizan los estudios de desarrollo de juegos "triple A" o las principales películas, por supuesto, por lo que estos estudios de gama alta no abandonan sus estudios equipados con mo-cap para iPhone ahora. Pero ahora, los creadores individuales y los equipos más pequeños pueden hacer algo que antes tenía un costo prohibitivo.

Apple agregó recientemente un sensor lidar al iPad Pro, y hay muchos rumores en Internet de que también llegará al menos a una de las variantes de la nueva línea de iPhone en 2020.